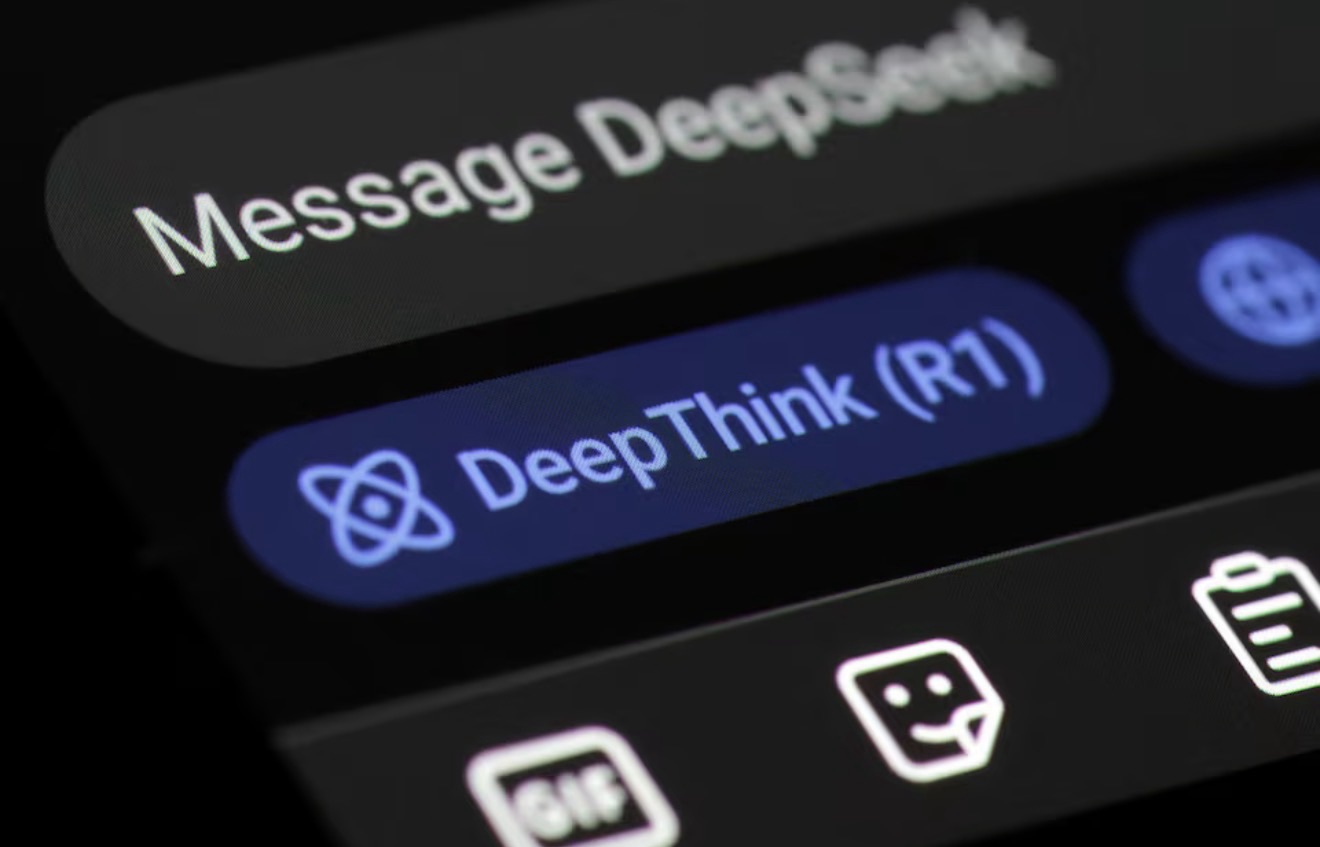

Кинеската компанија за вештачка интелигенција „DeepSeek“ го претстави својот најнов експериментален модел DeepSeek-V3.2-Exp, кој според компанијата е поефикасен во учењето и подобар во обработката на долги текстуални низи од претходните верзии.

Компанијата со седиште во Хангжу го опиша моделот како „чекор кон архитектурата од следната генерација“ на своите големи јазични модели, потенцирајќи дека новиот механизам DeepSeek Sparse Attention може значително да ги намали трошоците за пресметка и да ја подобри ефикасноста на специфични типови модели.

„DeepSeek“ објави дека трошоците за нивните API интерфејси се намалуваат за повеќе од 50 отсто, што би можело да ги направи услугите попристапни за програмерите. Иако моделот веројатно нема да го предизвика истиот глобален ефект како претходните изданија V3 и R1, тој може да ги стави под притисок домашните конкуренти, како Qwen на „Alibaba“, како и американските компании, доколку покаже високи перформанси со значително помали ресурси за обука.

Новото издание го нагласува растечкиот потенцијал на кинеските компании во областа на напредната вештачка интелигенција и конкуренцијата на глобалниот пазар на големи јазични модели.